Những công nghệ ứng dụng trí tuệ nhân tạo (AI) đang tạo ra những mối nguy đáng báo động trong cộng đồng xã hội qua các chiêu thức đánh lừa ngày một tinh vi hơn.

- Ai yêu cà phê thì về Buôn Ma Thuột

- Thị trường Bánh Trung thu 2023 có gì mới lạ?

- Biến thách thức thành cơ hội để ngành Cà phê bứt phá

- Lâm Đồng nâng cao năng lực Chuyển đổi số cho Doanh nghiệp

- VJBA “bà mối” của nhiều Doanh nghiệp Nhật đến vùng đất tiềm năng dưới chân núi LangBiang

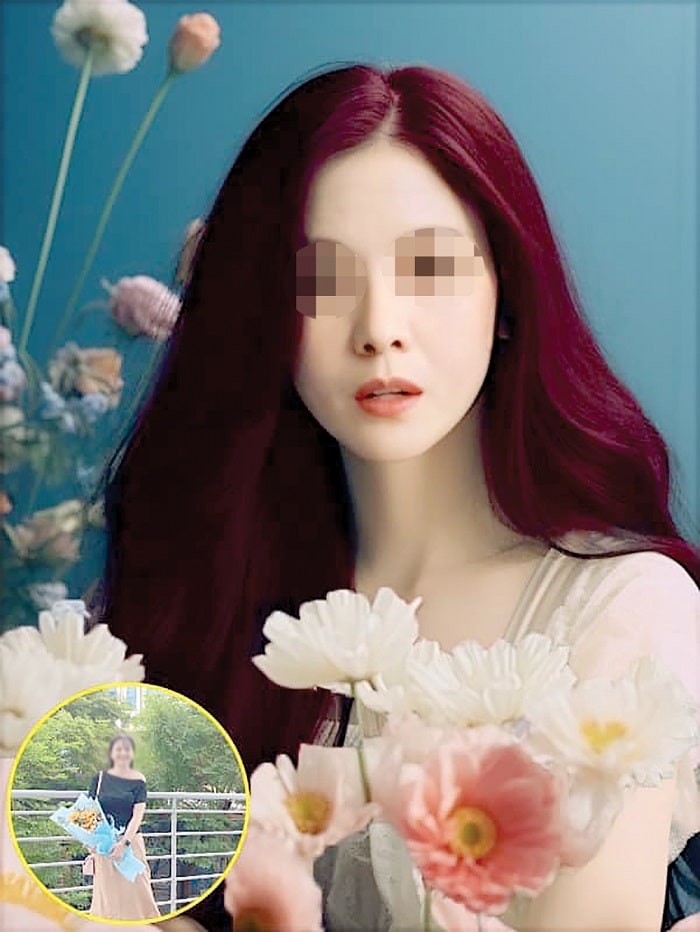

Trong đó, công nghệ “deepfake” được phát triển gần đây đang thu hút nhiều người dùng, nhất là giới nữ về việc ghép ảnh của mình vào các hình hoa hậu, người mẫu thời trang… trông như thật, mà không biết rằng tiềm ẩn phía sau là những nguy cơ không lường hết được.

Mới đây, một người quen của tôi chia sẻ một đường dẫn tới video với chú thích “phim lộ hàng” của một nữ minh tinh nổi tiếng. Khi bấm vào đường dẫn đó, người ta ngạc nhiên khi nhận ra gương mặt của một nữ diễn viên trẻ trong trang phục sexy và đang “thân mật” với một người đàn ông. Một chuyên gia công nghệ cho biết, đây chẳng phải phim ảnh gì thật mà chỉ là trò lừa đảo công nghệ, sử dụng công nghệ “deepfake” dựng hình ảnh người khác thôi.

Chuyên gia này còn thông tin thêm, trong vòng 10 ngày qua, mạng xã hội xuất hiện trào lưu gửi hình ảnh chân dung vào phần mềm ứng dụng trí tuệ nhân tạo, để có được những bức ảnh “rất đẹp như thật”. Nhiều bạn trẻ rất thích điều này, thậm chí hướng dẫn cho nhau nên chọn phần mềm nào thông minh hơn, ghép được nhiều hình ảnh đẹp hơn, tựa như diễn viên, người mẫu nổi tiếng… Một số phần mềm ứng dụng còn cho phép ghép ảnh vào trong video. “Tuy nhiên, hiểm họa ẩn phía sau trò chơi này thì chẳng ai có thể đoán trước được. Đơn giản là một ngày nào đó, bạn sẽ thấy hình ảnh mình trong thân thể sexy trần truồng nào đó”, chuyên gia trên cảnh báo.

Truy tìm ngược lại thông tin, có thể thấy công nghệ “deepfake” được phát triển dựa trên nền tảng machine learning (học máy), sử dụng mã nguồn mở của hãng Google. Thuật ngữ “deepfake” là kết hợp hai cụm từ “deep learning” và “fake”, tức là học chế tạo giả lập. Công nghệ này thực hiện quét video và ảnh chân dung của một người dùng cụ thể, rồi hợp nhất với video hoặc ảnh riêng biệt khác để tạo ra bức ảnh hay đoạn clip. Nhờ sử dụng tính năng thông minh của AI, công nghệ này có thể thay thế các chi tiết nhận dạng cơ bản có trên gương mặt người như mắt, miệng, mũi, cùng tốc độ chuyển động của gương mặt, và âm thanh giọng nói để tạo ra bản sao gần như thật. Quá trình này càng có nhiều dữ liệu hình ảnh gốc thì tính năng AI càng thuận lợi học hỏi và có thể tạo ra một gương mặt, hình ảnh người giả giống hệt người thật.

Với sự phát triển nhanh chóng của công nghệ, “deepfake” đang nhanh chóng lan tỏa vào nhiều lĩnh vực ứng dụng của cuộc sống, đơn giản như có thể giúp một người chọn được mẫu tóc thời trang ưng ý cho mình, hay thử thiết kế một bộ y phục nào đó. Mục tiêu ứng dụng của công nghệ vì thế rất tích cực và được nhiều người dùng tán thưởng. Song, mặt sau của vấn đề lại là cơ hội cho những đối tượng, tội phạm sử dụng vào các mục đích xấu.

Theo đó, những người dùng cung cấp ảnh chân dung hay video của mình cho các phần mềm giả lập ghép hình trên mạng sẽ rất dễ trở thành nạn nhân những trò tiêu khiển rẻ tiền, như ghép ảnh khỏa thân, kích dục… Những người ghép ảnh có thể chỉ giải trí, nhưng cũng có thể dùng những hình ảnh ngụy tạo đó để tấn công người khác, bêu riếu, bôi nhọ hay tống tiền, xúc phạm danh dự người khác và cả làm nhầm lẫn, phá vỡ quan hệ của những người liên quan.

Thứ hai, tội phạm có thể sử dụng AI để tạo nên những nhân vật giả, thực hiện lừa đảo qua mạng như gọi điện thoại cho người thân, bạn bè mượn tiền, ăn cắp thông tin phục vụ các mục đích xấu. Thậm chí, kẻ xấu còn có thể giả lập làm người dùng để đăng nhập vào các ứng dụng công nghệ trực tuyến, mua bán thanh toán qua mạng, qua thẻ ngân hàng… chiếm đoạt tài sản. Từ đó, các đường dây lừa đảo, tống tiền, khủng bố có thể sử dụng những tài khoản ảo, với nhân vật giả lập để thực hiện các hành động xấu.

Giới công nghệ hiện đã tạm thống kê ra nhiều phần mềm và công cụ website phổ biến dùng công nghệ “deepfake” như reface, zao, avatarify, deepfakes web β, myheritage, wombo… song danh sách này sẽ có thể dài hơn, đa dạng hơn bởi tốc độ phát triển nhanh chóng của công nghệ. Do đó, giới an ninh mạng đều đang lên tiếng cảnh báo người dùng phải hết sức lưu ý, cẩn thận với chiêu trò lừa đảo qua công nghệ deepfake. Nếu không cẩn thận, sẽ có một ngày người dùng chợt nhận ra có ai đó giả làm mình để rút tiền tại ngân hàng, hay… lên mạng phát biểu… khủng bố chính trị về vấn đề nào đó.

Những cô gái và chàng trai đang hớn hở khoe những tấm ảnh mạng, giả lập lại hình ảnh của mình, ghi nhận lại những khoảnh khắc kỷ niệm nào đó, hãy nên thận trọng xem xét lại. Bởi sẽ chẳng có gì miễn phí an toàn cho người dùng tuyệt đối, và mọi hành động bất cẩn sẽ có thể lãnh hậu quá rất đáng tiếc về sau. Cộng đồng mạng có câu “vui thôi, đừng vui quá”, có lẽ phù hợp để nhấn mạnh về cảnh báo này!

Thụy Bất Nhi

- Phát huy Phong cách người Đà Lạt trong Kinh doanh

- Hiệp hội Doanh nghiệp Lâm Đồng ‘bắt tay’ Fiore Group hỗ trợ hội viên

- Doanh nghiệp Lâm Đồng được giảm tiền sử dụng nước trong 6 tháng

- Thủ thuật nội soi bàng quang nhầm bệnh nhân, Bệnh viện đa khoa Lâm Đồng nói gì?

- Sắp diễn ra Hội nghị thường niên Hiệp hội Doanh nghiệp Khoa học và Công nghệ Việt Nam